La empresa de inteligencia artificial Anthropic ha iniciado una investigación urgente tras detectar un presunto acceso no autorizado a Claude Mythos, su modelo más sensible y restringido. Este sistema, diseñado específicamente para identificar vulnerabilidades críticas en software y infraestructuras digitales, representa un activo de alto valor estratégico. La brecha de seguridad planteada genera alertas internacionales sobre la posible exposición de datos sensibles que podrían ser utilizados por actores maliciosos para comprometer la ciberseguridad global.

Un activo crítico para la defensa digital

Claude Mythos se distingue por su capacidad de analizar códigos complejos y detectar fallos en sistemas que otros modelos de IA no podrían identificar. Al ser una herramienta de doble filo, su acceso no autorizado implica riesgos significativos para la estabilidad de redes corporativas y gubernamentales. La empresa ha confirmado que el incidente está siendo tratado con la máxima prioridad, activando protocolos de respuesta a incidentes para contener cualquier fuga de información y evaluar el alcance del compromiso.

Implicaciones para la seguridad nacional y económica

La vulnerabilidad de herramientas de IA avanzadas subraya la necesidad de fortalecer las defensas cibernéticas a nivel global. En un contexto donde la tecnología es un pilar fundamental para la economía y la seguridad nacional, cualquier brecha en sistemas de detección de vulnerabilidades puede tener repercusiones en cascada. Expertos en ciberseguridad advierten que la exposición de este tipo de modelos podría facilitar ataques dirigidos a infraestructuras críticas, desde servicios financieros hasta redes de energía, afectando la estabilidad económica de las naciones.

"La seguridad de los modelos de IA restringidos es vital para prevenir que actores hostiles exploten debilidades sistémicas antes de que sean parcheadas", señalan analistas del sector tecnológico.

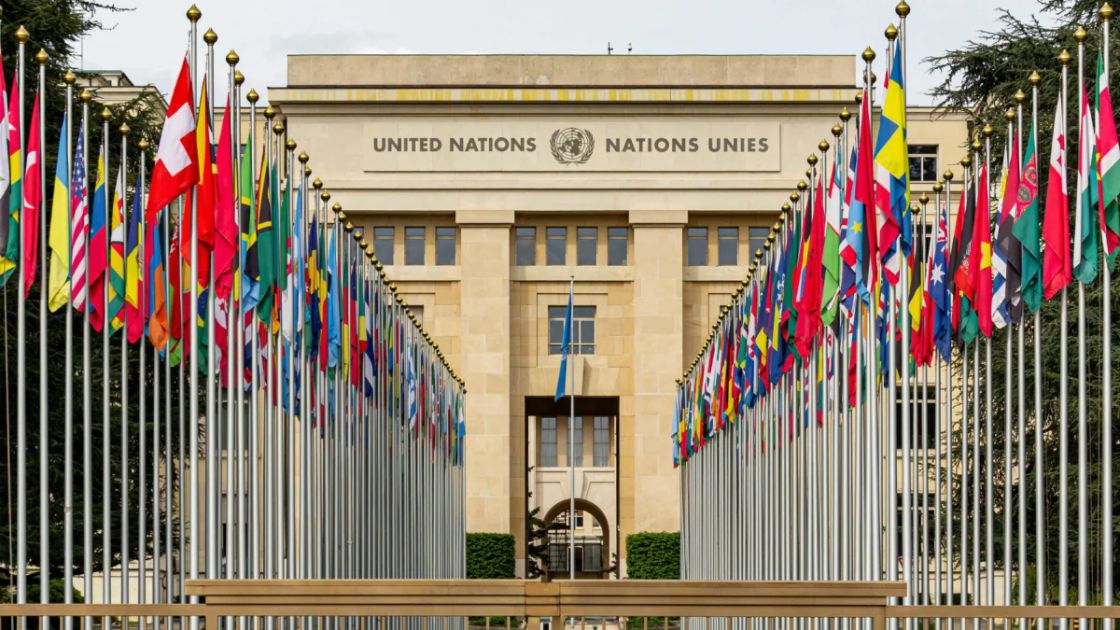

Este incidente refuerza la importancia de las regulaciones estrictas sobre el desarrollo y despliegue de inteligencias artificiales de alto impacto. Gobiernos y organismos internacionales deberán considerar nuevas medidas de protección para salvaguardar la propiedad intelectual y los algoritmos sensibles, asegurando que la innovación tecnológica no se convierta en una vulnerabilidad estratégica.